DLAS: Deep Learning Attitude Sensor

DLAS

DLASとは、民生品を使った安価な姿勢センサを開発するプロジェクトであり、その中のオンボードで衛星画像を分類するプロジェクトのコアアルゴリズムの開発を担当しました。 また、全体プロジェクトのプロジェクトマネージャを務めました。 より詳細はこちらから。

開発の経緯(建前)

TSUBAMEのページでも書いたように、人工衛星は1日に地上と通信できるのが40分程度、かつダウンリンク容量が非常に限られている(TSUBAMEだと10Kbps。実質数MB/day)ので、いかに無駄なデータを省くかが重要となります。

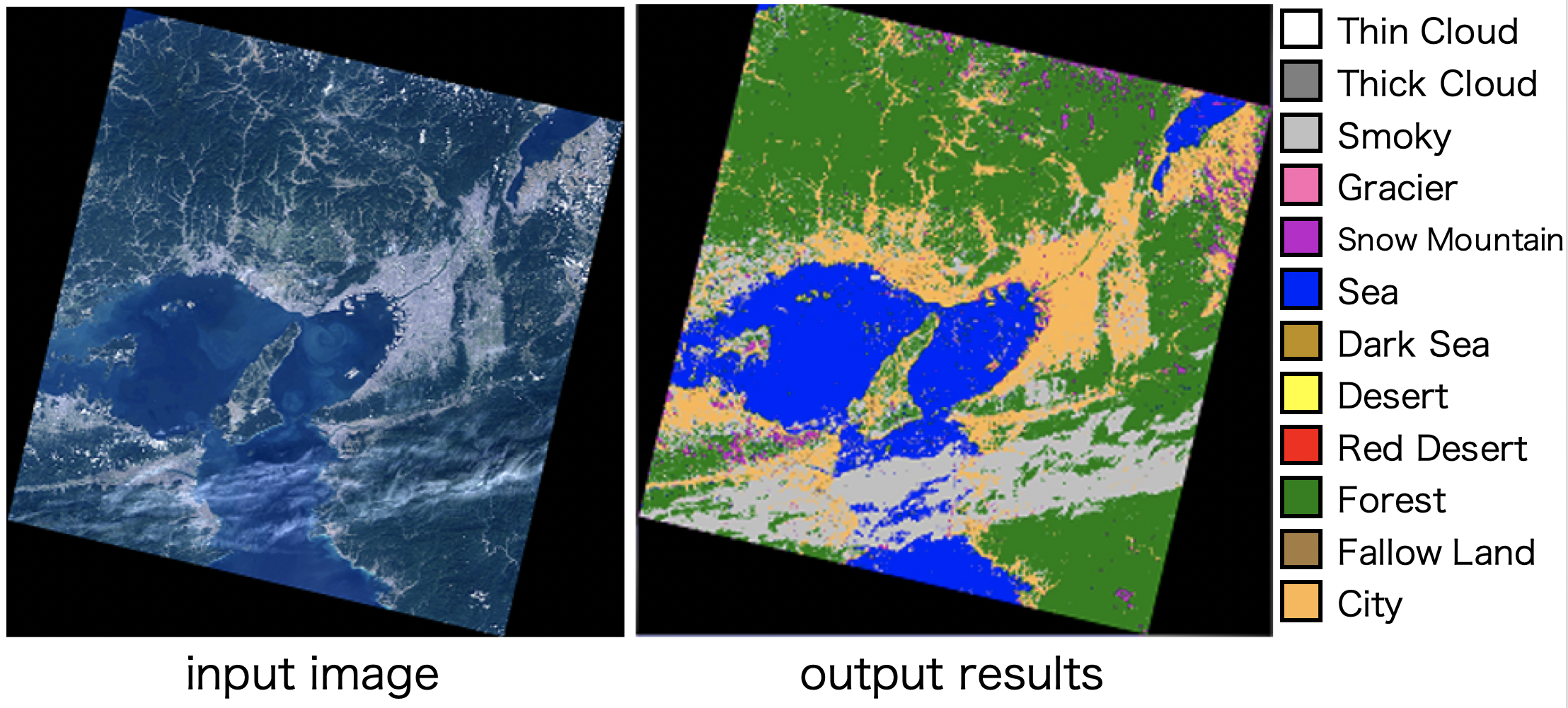

撮影した衛星画像をオンボードで自律的に分類できると、例えば雲の部分をマスク(撮影してみるとかなりの部分を雲が占めています)して圧縮率を高められます。 また、より効率を追求すると、興味のある現象(火山の噴火など)だけを検出しその座標を送るだけという運用にすれば極めて小さいデータ量で目的を完結できます。

このような理由で、オンボードで衛星画像を分類できることは非常に有益と言えます。

開発の経緯(本音)

修士1年の学生だった当時、ディープラーニングなる謎の技術が流行し始めていた時期で、岡谷先生の深層学習本を買い、C++で実装して遊んでいるうちにハマってしまいました…

オンボード衛星画像分類

人工衛星に搭載する計算機は宇宙の過酷な放射線・真空・熱環境で動作するために非常に低性能なもの(クロック数:数百MHz)に限られます。 したがって、プログラムは軽く、高速に動作する必要があり、(当時流行っていた)Caffeなどは使えません。 そこで、衛星搭載用にC++でMLP、CNNを一から実装しました。

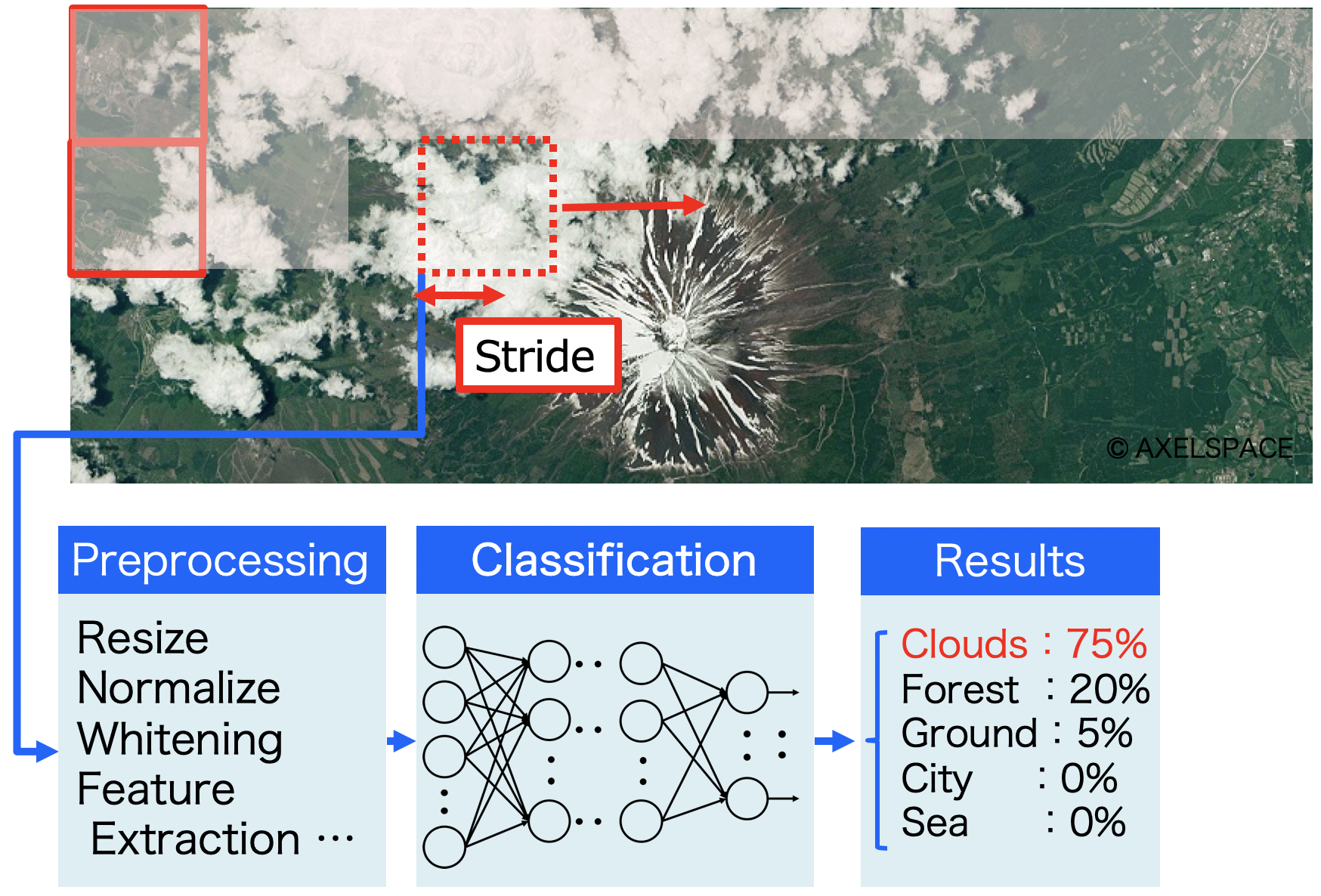

当時流行り始めていたFCNのようなリッチなものは(そもそも解像度的にも)使えず、古典的なスライディングウインドウ方式で画像を分類しました。

LandSatでの検出結果はこちら。

打上げ

卒業後は優秀な後輩たちに引継ぎ、2019/1/18に打上げられ現在軌道上実証中です。 撮影した写真をFacebookからいくつか拝借。

おまけ

- 開発風景が趣深い…